Google выпустил Gemini 3 — новую модель ИИ, которая планирует задачи и выполняет их самостоятельно, работая с текстом, изображениями, видео и кодом через платформу Antigravity.

Почему это важно: Раньше ИИ отвечал на вопросы. Теперь он сам делает работу от начала до конца. Вы ставите задачу. Агент открывает редактор кода, пишет программу, запускает тесты, проверяет результаты. Без вашего участия.

Главное: Gemini 3 обрабатывает до миллиона токенов (единиц текста, которые ИИ читает за раз). Это целые документы, часовые видео, аудиозаписи и репозитории кода. Модель обучена на процессорах TPU (чипах, которые ускоряют работу нейросетей) от Google DeepMind.

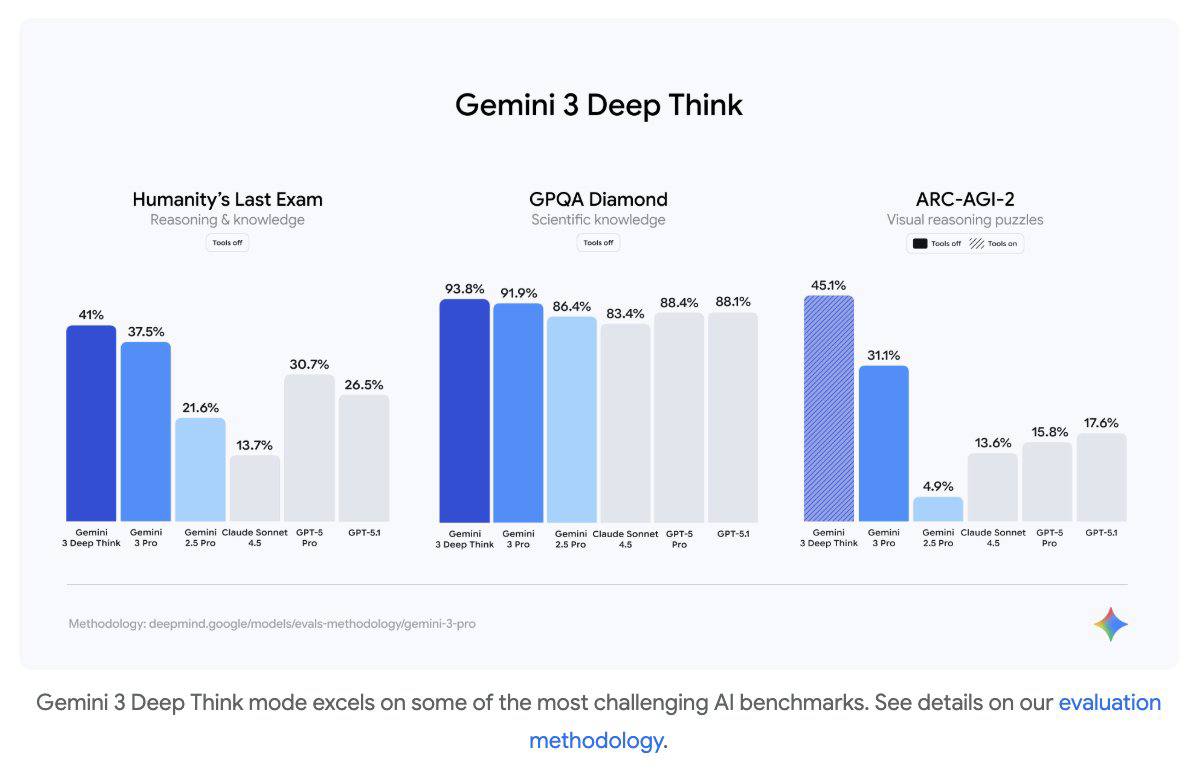

Предыдущая версия Gemini 1.5 Pro анализировала большие объёмы данных. Серия Gemini 2.x добавила режим Deep Think. Он позволяет ИИ рассуждать пошагово. Gemini 3 расширяет эти возможности. Теперь модель не просто анализирует. Она действует.

Что делает Antigravity: Antigravity — это агентная платформа (система, где ИИ сам планирует шаги для решения задачи). Она работает на базе Gemini 3. Агенты получают доступ к трём инструментам:

- Редактор кода

- Терминал для запуска программ

- Браузер для проверки результатов

Студент из Томска ставит задачу — проанализировать датасет погоды за год. Агент сам пишет скрипт на Python, запускает его в терминале, строит графики, сохраняет отчёт. За 10 минут. Без единой подсказки.

Разработчик говорит: создай форму регистрации. Агент открывает редактор, пишет HTML и CSS, запускает страницу в браузере, проверяет на ошибки. Исправляет их сам. Готово.

Как это работает: Antigravity интегрирована с Gemini 2.5 Computer Use. Это технология, которая позволяет ИИ управлять браузером. Модель видит экран. Она кликает на кнопки, заполняет формы, переходит по ссылкам. Как человек.

Ещё одна интеграция — Nano Banana. Это компактная версия Gemini 2.5 Image. Она быстро редактирует изображения. Обрезает, меняет цвета, накладывает фильтры. Прямо внутри рабочего процесса агента.

На фоне рынка: Gemini 3 конкурирует с несколькими моделями:

- OpenAI GPT-4o — работает с текстом и изображениями, но видео обрабатывает фрагментами

- Anthropic Claude 3.5 и 4 — сильны в рассуждениях, но пока без агентных возможностей

- Meta Llama 4 — открытая модель, но требует больше настройки

- Mistral AI — быстрая, но с меньшим контекстом

В отличие от GPT-4o, Gemini 3 работает с видео длиной до часа. Он анализирует весь ролик целиком. Не по кадрам.

Google интегрирует модель в свои продукты. Поиск станет умнее. Workspace получит автоматизацию задач. Android — голосового агента. Vertex AI — инструменты для разработчиков.

Что это значит: Доступ к Gemini 3 и Antigravity для разработчиков пока уточняется. Google не раскрыл детали регистрации. Но технология уже работает. Агенты тестируются внутри компании.

Это меняет подход к работе. Джуниор-разработчик раньше писал простые функции. Теперь агент делает это быстрее. Тестировщик проверял код вручную. Агент запускает тесты сам. Дизайнер искал ошибки в вёрстке. Агент находит их за секунды.

Что дальше: Вопрос не в том, заменит ли ИИ людей. Вопрос в том, как быстро команды научатся работать с агентами. Кто-то делегирует рутину и сосредоточится на сложных задачах. Кто-то будет конкурировать с ИИ в выполнении базовых функций.

Технология уже здесь. Остаётся понять, как её использовать эффективно.