En 2020, subir un video significaba esperar horas para aparecer en recomendaciones. En 2024, el algoritmo lo analiza en segundos. Lo que cambió no es solo la velocidad. Es cómo las máquinas ven el contenido.

Los sistemas de recomendación ahora interpretan texto, imagen y audio de forma conjunta. Extraen el tema, el estilo visual y el tono emocional, y los fusionan en una representación única que permite sugerir contenido relevante sin esperar la retroalimentación de los usuarios. Este cambio entrega ventajas inmediatas: distribución más rápida para creadores, búsquedas más precisas para espectadores y detección temprana de contenido problemático.

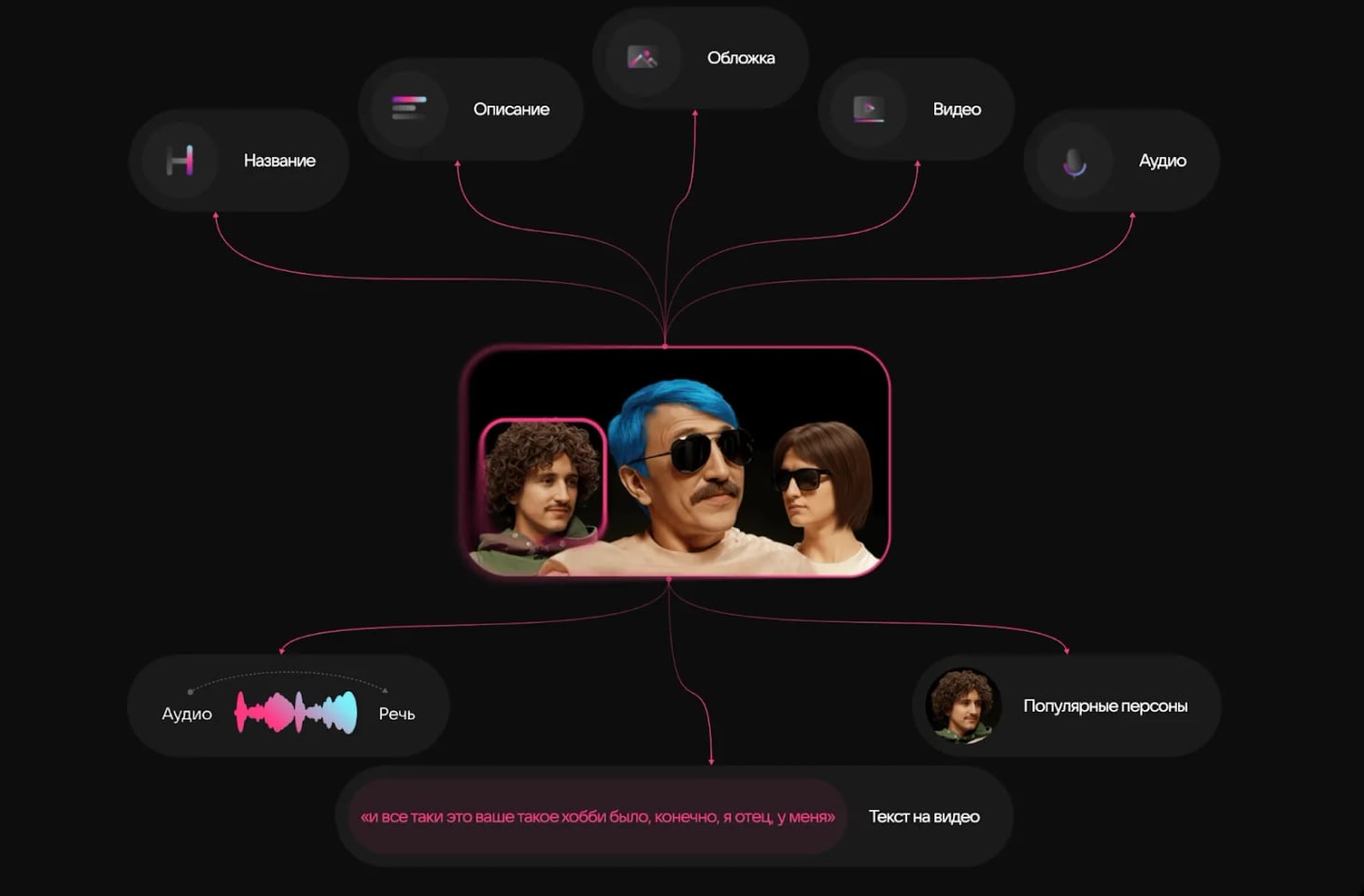

Lo que ve el algoritmo cuando subes un video

El sistema procesa cada modalidad por separado y luego las fusiona. Cada modalidad se convierte en un vector numérico llamado embedding multimodal. El embedding captura tema, estilo visual y tono emocional en un solo vector compacto.

Piensa en ello como traducir español, inglés y lenguaje de señas a un idioma universal que la máquina entiende. Con esa unidad, el motor compara contenidos sin depender de etiquetas superficiales ni de palabras clave.

En pruebas realizadas por VK, el proceso tarda menos de un segundo por video de tres minutos. Los sistemas unimodales requerían varios segundos y dependían de la retroalimentación inicial de los usuarios.

Cuando una foto, un sonido y una palabra se vuelven lo mismo

Los modelos convierten formatos distintos en el mismo espacio vectorial. Una foto de montaña, una pista de viento y la frase «alpinismo» terminan cerca una de otra en ese espacio abstracto.

El entrenamiento usa contrastive learning: los ingenieros alimentan al modelo con pares de contenido relacionados y no relacionados. El algoritmo aprende a acercar en el espacio vectorial los pares que describen el mismo objeto y a alejar los que no tienen conexión.

Con millones de ejemplos, la red reconoce patrones complejos. Un usuario sube una foto desde el Zócalo, y el sistema encuentra videos de eventos culturales en plazas públicas sin que nadie haya etiquetado la imagen.

Recomendaciones sin esperar las primeras vistas

Al subir un video, el sistema ya dispone de una descripción compacta del contenido. Esto acelera la distribución porque no se espera a que los primeros espectadores lo califiquen. Según el informe de IDC, la latencia de recomendación se redujo un 30 % en plataformas que adoptan modelos multimodales.

Para creadores mexicanos en TikTok o YouTube, esto significa alcance inmediato. Un video de receta de mole negro aparece en los feeds de usuarios interesados en gastronomía oaxaqueña segundos después de subirlo, no horas más tarde.

Buscar con imágenes o sonidos, no solo palabras

Los usuarios suben una fotografía y obtienen videos con estética similar en menos de dos segundos. De igual forma, una muestra de audio de una canción permite encontrar clips que comparten la misma atmósfera sonora. Esta búsqueda basada en asociaciones sustituye las palabras clave tradicionales y mejora la precisión de resultados.

Un ejemplo local: grabas unos segundos de la Guelaguetza y el sistema te muestra documentales sobre danzas tradicionales, tutoriales de vestuario y entrevistas con artesanos. Sin escribir una sola etiqueta.

Detectar contenido problemático antes de que circule

El modelo cruza señales para identificar inconsistencias entre imagen y audio. Un video con imágenes inocentes pero lenguaje ofensivo en la pista de audio se marca automáticamente. En pruebas de VK, la tasa de detección de contenido nocivo aumentó un 18 % frente a sistemas que analizan cada modalidad por separado.

Esta capacidad reduce el tiempo de exposición a contenido dañino. Las plataformas actúan antes de que el video acumule vistas, protegiendo a los usuarios y simplificando la moderación.

Una preferencia en artículos influye en sugerencias de video

El embedding unificado permite que tus elecciones en un formato afecten otro. Si diste «me gusta» a un artículo de viajes, el algoritmo infiere interés por paisajes y muestra videos de destinos turísticos sin requerir entrenamiento adicional. Para creadores, la campaña puede diseñarse una vez y desplegarse en varios formatos simultáneamente.

Esto simplifica la estrategia de contenido. Un fotógrafo mexicano publica una serie sobre cenotes y el sistema recomienda sus videos, galerías y entrevistas escritas a la misma audiencia, sin segmentar manualmente.

Explicar por qué el algoritmo sugiere un video

Los sistemas empiezan a justificar sus decisiones con referencias claras. En lugar de «Puede que te guste», el mensaje indica «Recomendamos este video porque calificaste una escena de montaña en un clip anterior». Esto entrega transparencia y permite a los usuarios ajustar sus preferencias con mayor precisión.

Además, los modelos generan collages a partir de fotogramas favoritos o crean listas de reproducción según la hora del día y el clima. Un usuario en Monterrey recibe recomendaciones matutinas diferentes a las nocturnas, adaptadas a sus patrones de consumo.

Los desafíos que aún frenan la adopción

El entrenamiento de modelos multimodales exige grandes recursos computacionales. Los centros de datos deben disponer de GPUs de alta gama y consumir energía significativa, lo que eleva los costos operativos. Los investigadores señalan que equilibrar precisión y eficiencia sigue siendo un desafío abierto.

Para plataformas locales con presupuestos limitados, implementar estos sistemas representa una barrera técnica y financiera. La infraestructura de nube ayuda, pero los costos recurrentes pueden ser prohibitivos.

Qué significa esto para creadores y usuarios mexicanos

Con 62.2 millones de usuarios mexicanos accediendo a contenido audiovisual, la adopción de IA multimodal transforma la experiencia digital. Según la encuesta de NTT Data, el 77.7 % de las organizaciones latinoamericanas ya emplean IA generativa, lo que indica un ecosistema preparado para integrar estas tecnologías.

Los creadores ganan alcance sin esperar. Los usuarios encuentran contenido relevante sin escribir consultas complejas. Las plataformas moderan de forma más efectiva. La tecnología se vuelve invisible: funciona en segundo plano mientras tú subes, buscas y descubres.

Si produces contenido, considera que los algoritmos ahora ven más allá de las etiquetas. Cuida la coherencia entre lo que muestras, lo que dices y lo que escribes. Si consumes, aprovecha las nuevas formas de búsqueda. Sube una imagen, graba un fragmento de audio, deja que el sistema trabaje. La máquina ya aprendió a hablar tu idioma.